AI開発者の社会的関心事のトップはユーザーデータ、業務スキルの変化

Bias in Training Can be Addressed with Diversity of Data Sources

トレーニングにおけるバイアスはデータソースの多様性で対処できる

Santa Cruz, CALIF . (Aug 26, 2024)

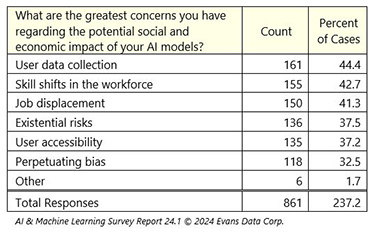

– Developers working on AI projects

feel that AI’s extensive collection of

user data will have the biggest

social and economic impact from

the AI models they’re working on

according to Evans Data’s just

released AI & Machine Learning

Survey Report. Considering the

issues that have been identified

from data collection including privacy encroachment, social scoring, and identity

theft, it’s not surprising that this topped the list of concerns. However , both skill

shifts in the workforce and job displacement were within margin of error of the

top reflecting a realization that the workforce, including software development, is

changing. In fact, when asked when they expect AI to be able to take over the role

of an AI developer , 46% thought within one year while 22% said it already has.

カリフォルニア州サンタクルーズ(2024年8月26日) エバンスデータが発表したばかりの「AI

と機械学習に関する調査報告書」によると、現在AI関連のプロジェクトに取り組む開発者た

ちは、AIにより収集された広範囲に及ぶユーザーデータが、社会的・経済的に最も大きな

影響力を持っていると感じている。プライバシーの侵害、ソーシャルスコアリング、個人情報

の盗難など、データ収集において頻繁に発生する問題を考慮に入れれば、このことが懸念

事項のトップになったことに驚きはない。しかし、業務スキルの変化と失業の二つがトップと

僅かな範囲内にランクインしていることは、この仕事に従事する人々が変化していることを

反映している。実際、「AIがAI開発者の役割を引き継ぐようになるのはいつ頃になると思う

か」という質問に対し、46%が1年以内と答え、22%がすでに引き継ぎは起きている、と答

えている。

Now in its 15th edition, this worldwide survey of developers working with AI or ML

also looked at the hot topic of bias as a societal issue. In that case over 46% of

developers identified algorithmic bias testing as critical to addressing potential

ethical issues while in development.世界でAIやMLを扱う開発者を対象としたこの調査は、今回で15回目となった。今回は、社

会的な関心が高まっている、AIのバイアス問題についての調査も行われた。調査では、開

発者の46%以上が、開発中に起こり得る倫理的問題に対処するため、アルゴリズムに基

づいたバイアステストが不可欠であると考えている。

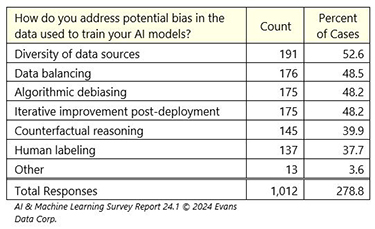

Bias can also be a focus when

training models and over half of

those training models cited a need

for diversity of data sources as the

top consideration. Next in

importance, a statistically equal

percentage cited data balancing,

algorithmic debiasing and iterative

improvement post development.

Algorithmic debiasing is a natural

complement for data diversity since it directly addresses and corrects biases within

the model itself, enhancing fairness without relying solely on data diversity .

AIモデルの学習に際しても、バイアスに重点が置かれることがある。その際、半数以上の

回答者が、データソースの多様性を最重要事項ととらえている。今回の調査では、多様性

と同率でデータの平等性(データバランシング) が、ほぼ同率でアルゴリズムによるデバイ

アシング(非バイアス化)、そして開発後の持続的なバイアス改善が、挙げられた。アルゴリ

ズムによるデバイアシングは、AIモデルの様々なバイアスを直接改善・修正する補完作業

で、データの多様性に基づかなくとも、公平性を高めることができる。

Evans Data Corp’s biannual AIML Development survey provides fresh data on

current AIML development topics. It covers a wide array of current topics ranging

from AI and machine learning in the cloud, Generative AI, Speech and Image

Recognition, Frameworks, Workloads, and more . For an in-depth view of the

topics addressed, view the full table of contents and more at

エバンスデータが年2回実施するAIML開発調査は、現在のAIML開発の様々なトピックに関

する最新のデータを提供するものです。クラウドにおけるAIや機械学習、生成AI、音声・画

像認識、フレームワーク、ワークロードなど、幅広く最新のトピックがカバーされています。

取り上げたトピックの詳細については、https://evansdata.com/aiml をご覧ください。